深度学习领域改进 YOLO-HRA 手势识别算法研究论文

2026-03-30 14:54:44 来源: 作者:xuling

摘要:针对深度学习领域现有手势识别算法在复杂背景下识别效率低、准确率不足的问题,基于YOLO(You Only Look OnceGesture)算法原理,提出了一种基于改进YOLO算法的手势识别算法YOLO-HRA(YOLO-Recognition Algorithms)。

摘要:针对深度学习领域现有手势识别算法在复杂背景下识别效率低、准确率不足的问题,基于YOLO(You Only Look OnceGesture)算法原理,提出了一种基于改进YOLO算法的手势识别算法YOLO-HRA(YOLO-Recognition Algorithms),论述了改进YOLO-HRA手势识别算法模型构建、多尺度输入优化、边缘检测优化方法,并在NUS-II和Marcel两个复杂背景数据集上进行了检测精度、定位准确度验证。结果显示,改进YOLO-HRA手势识别算法在两数据集上的识别效果均优于YOLO网络和YOLOv5网络。

关键词:深度学习;手势识别;YOLO算法;卷积神经网络;多尺度输入;边缘检测

0引言

在当前人工智能快速发展的背景下,手势识别作为人机交互的重要环节和场景之一,是当前机器学习的重要研究领域。传统基于支持向量机(SVM,Support Vector Machine)、方向梯度直方图(HOG,Histogram of Oriented Gradients)等构件的手势识别算法,均存在不同程度的时间开销大、算法复杂、识别效率低等问题[1]。近年来,随着卷积神经网络(CNN,Convolutional Neural Network)被越来越多地应用于计算机视觉领域,基于CNN、深度信息的手势识别算法取得了良好的应用效果,显著提升了手势识别率,但仍然存在算法鲁棒性较差、特定相机设备依赖度高等问题[2]。基于此,本文提出了一种基于YOLO算法的手势识别算法YOLO-HRA,旨在为复杂背景下基于视觉的手势识别提供一种高效率、高鲁棒性的算法。

1 YOLO算法原理

YOLO是一种基于深度学习的目标检测算法,其网络结构包括骨干网络(Backbone)和检测头(Detection Head)两部分,其中Backbone负责图像特征提取,Detection Head用于对图像特征进行处理,可准确识别物体的位置、所属类别及置信概率,实现高效率、端到端的目标检测[3]。

YOLO算法在对输入图像进行特征处理时,会将图像划分为S1×S2个网格单元,每个网格单元负责预测一定数量的边界框及其类别概率(置信度),其表达式如式(1)所示:

Cb=P(O)·L(1)

式中,Cb为边界框预测置信度;P(O)为边界框内包含检测目标的概率;O表示边界框中包含检测目标;L为交并比,用于衡量物体边界框位置和物体实际位置的重叠程度。

每个边界框预测结果都包含边界框中心坐标(x,y)、高度h、宽度w及置信度5个参数。每个网格单元都包含边框预测结果的类别概率P(s|O),表征边框内物体的所属类别s的预测概率。根据边界框内包含检测目标的概率P(O)及类别概率P(s|O),可算得任意边界框的具体类别置信率,其表达式如式(2)所示:

Csi=P(si O)·Cb(2)

式中,Csi为第i个类别的置信率,用于表征边界框精确度和其中检测目标的类别概率。

YOLO的损失函数由回归损失EC、分类损失EL和置信度损失ES 3部分构成,分别用于表征预测值与实际值间坐标、交并比和分类误差。

2基于改进YOLO算法的手势识别算法构建

YOLO作为一种先进的深度学习目标检测算法,在人、动物、车辆等物体检测中具有良好的应用效果,但此类检测目标在图像中占据较大的幅比。而人手在整幅图像中的占比较小,且检测图像尺寸离散性较大,检测阶段容易出现漏检、误检等问题。同时,手势检测需要排除图像中的背景干扰,单独对人手势进行检测。而YOLO算法侧重于多目标检测,算法网络过于臃肿,因此需要对算法进行针对性改进,提升手势识别准确率和算法鲁棒性[4]。

2.1 YOLO-HRA算法参数计算

本文提出的YOLO-HRA算法是一种基于YOLO算法的改进HRA算法。该算法通过简化YOLO算法中的部分卷积层、池化层,对其网络结构进行优化,同时通过减少剩余卷积层的卷积核个数,提升模型的计算效率,即通过牺牲原始模型的多目标检测能力,保证模型的单目标检测效率。同时,针对原始YOLO算法卷积核大小、步长过大的问题,将原始算法首层7×7卷积核减小为3×3大小,卷积层步长均由2减小为1,提升算法的小目标检测能力。模型最终输出、最下层卷积核参数X计算表达式分别如式(3)、式(4)所示:

ξHRA=S1×S2×X(3)

X=(5+N).B(4)

式中,ξHRA为HRA算法输出;S1×S2为网格单元数,S1=10,S2=7;X为最后一层卷积核数量;N为检测目标类别数量,取N=1;B为每个单元的目标边界框数,取B=5。

2.2多尺度输入优化

为克服人工特征提取复杂、特征难以捕捉的不足,提出了采用CNN网络进行手势区域的特征提取。但YOLO-HRA算法模型获取的手势区域中手势尺寸并不唯一,若采用传统图像裁剪、拉伸、缩放的方式对图像尺寸进行统一处理,虽然能够保证CNN输入尺寸的一致性,但会造成手势区域图像扭曲、信息丢失等问题,可能对手势识别准确率造成影响。为此,本文在卷积层之后和全连接层之前引入了空间金字塔池化(SPP,Spatial Pyramid Pooling)模块,优化CNN网络的多尺度输入问题。

可通过各金字塔层级对应的特定大小的池化窗口,对特征图进行不同尺度的划分和池化,提取出多尺度的特征信息,再将各个金字塔层级的池化结果进行合并,得到一个固定长度的特征向量,从而保证CNN网络输入的手势区域图像尺寸的一致性。具体而言,对于任意给定尺寸(w0×h0)的SPP特征图像输入,假设所构建的金字塔层包含n×n个空间盒。其池化窗口的大小为w1×h1,其中窗口的宽度w1=w0/n,窗口的高度h1=r h0/n 1,r·1表示向上取整,确保池化窗口能够覆盖整个特征图;对应池化窗口的水平方向上的步长为tw=L w0/n,竖直方向的步长为th=L h0/n」,L·表示向下取整,确保步长能够在特征图上进行均匀划分。若空间金字塔为m层,则经过上述池化处理操作后,再将m个池化结果合并,即可得到一个固定长度的特征向量输出。

2.3边缘检测优化

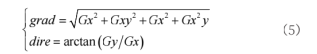

边缘检测是手势识别的重要环节,本文采用Canny算子进行边缘检测。为克服传统Canny算子的不足,本文提出了采用自适应中值滤波和双边滤波替换原算法的高斯滤波,提升复杂背景下手势边缘的提取精度[5],并通过Sobel计算其梯度幅值(grad)和梯度方向(dire),其计算表达式如式(5)所示:

式中,grad为图像滤波处理后得到的梯度幅值,反映图像中像素点在各个方向变化的剧烈程度;Gx、Gxy、Gy、Gyx分别为x、xy、y、yx4个方向上的一阶梯度分量;dire为图像滤波处理后得到的梯度方向,表征图像中某一点的边缘方向,其角度范围在-τ/2~τ/2之间。

该算法利用非极大值抑制法,可有效去除特征图像的虚假边缘,保证边缘检测的精度和准确度,同时,该算法通过梯度方向,将检测图像划分为4个同等大小的区域,再利用权重确定梯度两端的值,可以更加准确地确定边缘点的方向信息,为后续非极大值抑制等处理保留真实的边缘点,有效强化边缘,提升边缘检测效果。

2.4 YOLO-HRA算法构建

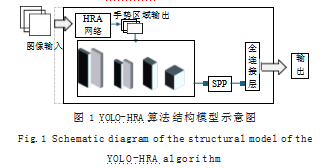

基于上述分析,建立了由4个卷积层构成的分类网络,用于提取手势区域图像的特征,各层卷积核数量依次为16、32、64、64,其大小均为3×3,步长为1,兼顾特征提取的精度、效率和细度,激活函数采用ReLU,正数输入时输出等于输入,复数输入时输出等于0。池化层采用最大池化,尺寸为2×2,步长为2,可以有效降低特征图尺寸对计算的影响,提升计算效率,增强网络的鲁棒性。全连接层包含512个神经元,用于对卷积层提取的特征进行整合,并将特征向量输入转变为线性输出,作为Softmax分类函数输入,输出表示手势区域每个手势类别的概率。YOLO-HRA网络使用SPP替代最下层卷积层后的池化层,其作用是将不同尺度的特征图输入,转化为固定长度的特征向量,保证CNN网络输入的一致性。YOLO-HRA网络结构模型如图1所示。

3结果验证

为验证本文所提出基于深度学习的YOLO-HRA手势识别算法的应用效果,分别在Marcel和NUS-II数据集上对模型进行了测试。试验平台配置CPU为Xeon E5-2666 v3,内存为32GB,GPU为GeForce RTX 4060,深度学习框架为TensorFlow-GPU2.7.0,编程环境为Python3.7。

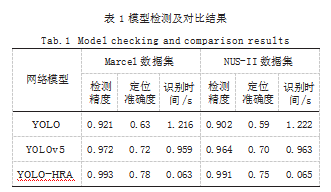

Marcel、NUS-II数据集是手势识别训练应用最广泛的两个公共手势数据集,其中Marcel数据集包含6种手势,其肤色统一,背景较为简单,共包含5494张手势图片;NUS-II数据集包含10种手势,肤色、背景较为复杂,共包含2750张手势图片。测试结果如表1所示。

由表1可知,YOLO-HRA算法在两种数据集上的检测精度均在0.99以上,检测精度、定位准确度、识别效率远优于原始YOLO算法和YOLOv5算法,且在复杂背景下(NUS-II数据集)的识别检测精度、定位准确度保持良好,表明该算法能够有效适应复杂背景下的手势识别要求。

4结语

综上所述,本文基于YOLO算法原理,提出了基于改进YOLO算法的手势识别算法,通过在卷积层之后和全连接层之前引入空间SPP层,解决了CNN网络的多尺度输入问题,同时采用自适应中值滤波和双边滤波替换原算法的高斯滤波,对Canny边缘检测算法进行了优化,提升了复杂背景下手势图像边缘识别的准确度。经实验验证,YOLO-HRA手势识别算法检测精度、定位准确度、识别效率均优于原始YOLO算法和YOLOv5算法,在复杂背景下仍能保持0.99以上的识别准确率,鲁棒性良好。

参考文献

[1]赵鸿图,李豪,梁梦华.复杂背景下多特征结合的深度学习手势识别[J].电子测量技术,2023,46(23):77-84.

[2]张群.基于轻量级卷积神经网络的人车交互手势识别研究[D].长沙:中南大学,2022.

[3]刘林.基于深度学习的手势识别算法及系统实现[D].西安:西安石油大学,2023.

[4]栾迪,周广证.基于深度学习的静态手势识别算法设计[J].信息技术与信息化,2021(5):98-99+102.

[5]张晓俊,李长勇.基于深度学习多特征融合的手势分割识别算法[J].济南大学学报(自然科学版),2022,36(3):286-291.