玫瑰自动扦插机图像识别算法研究论文

2026-03-24 15:53:03 来源: 作者:xuling

摘要:现有玫瑰扦插机多采用人工或复杂的专用机械机构实现插穗的有序供给,人工劳动强度大,机构复杂易出现故障。

摘要:现有玫瑰扦插机多采用人工或复杂的专用机械机构实现插穗的有序供给,人工劳动强度大,机构复杂易出现故障。为此设计了玫瑰自动扦插机视觉系统,实时采集传动带上无序摆放的插穗图像,对图像进行滤波锐化后转化为灰度图像,采用Canny算子检测插穗边缘并提取轮廓,根据其轮廓外接矩形获取插穗抓取角度,利用重心法计算抓取点坐标,并进行试验验证,抓取角度平均误差为1.5°,抓取点坐标平均误差为12.18像素,满足玫瑰自动扦插机作业需求,为扦插机全程自动化研究提供了技术支撑。

关键词:玫瑰扦插机;视觉系统;插穗自动识别;位置检测;试验验证

扦插是一种广泛应用于花卉、林木、药材及经济作物的无性繁殖方法。目前,扦插作业大多以人工操作为主,存在劳动强度大、作业效率低、标准化程度不高等问题,严重制约了相关产业的规模化发展。因此,研发自动化、智能化的扦插机,对于解放劳动力、提高作业效率与质量具有重要的理论意义与实践价值。

国内外学者针对不同作物的插穗特性与农艺要求开发了多种扦插机械[1-8]。目前,大多数研究集中于机械结构创新与优化方面,对关键机构进行了专用机械结构设计,采用各种现代设计方法并结合试验数据进行优化,显著提升了扦插机作业性能和可靠性。但扦插机整体智能化水平较低,取苗机构结构复杂且专用性强,针对插穗无序摆放、姿态异常等情况自适应能力较差,通用性不强。针对上述问题,苏微等采用YOLOv 5 s的图像识别技术用于康乃馨插穗的检测,研究表明采用机器视觉技术能够解决精准取苗和自适应作业的问题,有效提高作业精度和质量[9]。

玫瑰的观赏价值和经济价值均很高,常采用扦插法进行大规模繁殖。本文以玫瑰插穗为研究对象搭建了扦插机视觉系统,设计了插穗识别和定位的图像处理算法以精确识别插穗位置和抓取角度,为智能化扦插机的研究和应用提供参考。

1.视觉系统硬件设计

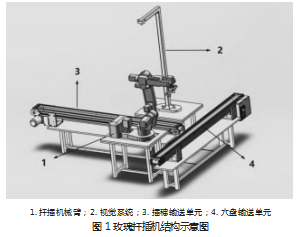

玫瑰自动扦插机由视觉系统、计算机、扦插机械臂、插穗输送单元、穴盘输送单元组成。视觉系统安装在插穗输送单元正上方采集目标图像,并通过USB接口上传到计算机进行图像处理,以获取目标的坐标位置和抓取角度,通过USB转串口模块把识别结果发送给机械臂,机械臂抓取玫瑰插穗并扦插到穴盘中。

设计的视觉系统包括相机、镜头、光源和计算机。综合考虑拍摄精度、实时性、工作距离等因素,选用海康威视的MV-CU120-10 UC的工业面阵相机和MVL-KF 0814 M-12 MPEFA镜头。同时,为避免环境光照的不利影响,采用白色LED光源以平行光进行补光。

2.插穗识别图像处理算法

首先对相机采集到的图像进行图像预处理,其中包括图像滤波、图像锐化增强以及灰度转换;其次,采用合适的图像分割算法对预处理后的图像进行图像分割;最后,提取分割后图像的轮廓特征,通过几何矩计算扦插枝条的形态、角度以及坐标。采用Py-charm软件,利用Python语言结合OpenCV库进行图像处理程序编写。

2.1图像预处理算法

为了更好地获取图像的边缘和轮廓特征,需要对图像进行预处理来消除不利因素对它的影响,同时为后续图像分割的准确性提供充足的准备。利用3 x 3卷积核比较高斯、均值、中值及双边法对图像去噪的处理效果后,经分析得出高斯滤波后直方图更加平滑,因此采用高斯滤波对图像进行降噪处理。

采用图像锐化技术使模糊图像变得更清晰。对比梯度法、Sobel算子法、Laplace算子法和高通滤波法处理后的图像,经分析高通滤波法相比原始图像具有更高的方差,图像中插穗轮廓更清晰,因此选择高通滤波法对图像进行锐化处理。

采用最符合人眼感知的加权平均值法获取灰度图像。加权平均值法保留了最主要的绿色通道亮度信息,计算公式如下:

Gray=0.114B+0.587G+0.299R(1)

式中:Gray为灰度值;B为蓝色通道值;G为绿色通道值;R为红色通道值。

2.2图像分割算法

为将插穗目标与背景输送带分离,选用了基于Canny算子的边缘检测算法,其核心思想是通过检测图像中灰度发生突变的位置,将它们连接起来以定位物体边界。Canny算子不是单一的算子,而是一个完整的处理流程,包括高斯滤波、计算梯度、非极大值抑制和双阈值分割。具体处理过程如下:首先对获取的灰度图像采用高斯滤波进行平滑,然后使用Sobel算子来计算梯度幅值和梯度方向找到可能的边缘点,并通过非极大值抑制确定图像中的真实边缘,得到单像素宽度的边缘,最后通过双阈值机制检查与边缘连接,确定真实边缘。

2.3轮廓特征提取算法

采用轮廓特征检测将图像中物体的边界提取出来,并在图中用封闭的曲线进行描绘,以获取物体的基本外形,为进行下一步抓取位置计算奠定基础。形态学处理可以通过结构元素和基本形态学操作(膨胀、腐蚀、开运算、闭运算等)去除噪声、填补空洞、连接断裂的区域、分离连接的区域等。对分割后的图像先进行两次膨胀操作然后进行一次腐蚀操作,使插穗目标外轮廓特征更明显,然后找到其轮廓并绘制出来,以便于确定玫瑰插穗的轮廓特征便于计算抓取位置。

2.4抓取位置获取算法

在实际工作场景中,输送带上存在多个玫瑰插穗目标。首先计算每个物体轮廓的面积,排除有重叠交叉的插穗,然后选取输送带传送方向上最前面的插穗作为优先抓取目标,然后通过创建掩膜的方法,与原图像进行按位与操作,单独分割出最优插穗图像。然后绘制最优插穗的最小外接矩形,经观察最优插穗的底部端点一定在最小外接矩形的某个角上,分析矩形四个端点周围的坐标,确定插穗底部位置,然后绘制该点的对角线作为目标插穗的旋转角度,并将该角度传送给机械臂,作为机械爪抓取该目标插穗的旋转角度。

为避免机械爪抓取点可能会对插穗叶片造成损害,影响作业效果,将最优插穗沿与旋转角度对角线的中垂线再割成上下两部分,然后通过参数对比分析找出枝条所在的部分,即插穗插入土中生根的部分,再利用重心法提取抓取点坐标并发送给机械臂。

3.试验验证与分析

3.1系统功能测试

对玫瑰自动扦插机视觉系统的软硬件功能进行了测试。系统软件工作流程如下:(1)连接海康威视摄像头,并设置相机参数和帧率,并读取摄像头的图像,图像大小设置为640×480;(2)对采集到图像进行高斯滤波,使用高通滤波法进行锐化处理,然后使用加权平均法将彩色图像转化为灰度图像;(3)使用Canny算子对灰度图像进行边缘检测,对图像中的物体进行分割;(4)经过形态学处理结果提取最优轮廓特征,并使用掩膜图像获取最优插穗的枝条图像;(5)插穗旋转角度为0—180°,枝条部分在下、叶片在上时定义为正角度,反之为负角度,绘制最优插穗的最小外接矩形,获取其旋转角度和正负方向;(6)分割最优插穗,获取枝条部分,根据重心法确定机械爪的抓取点坐标。

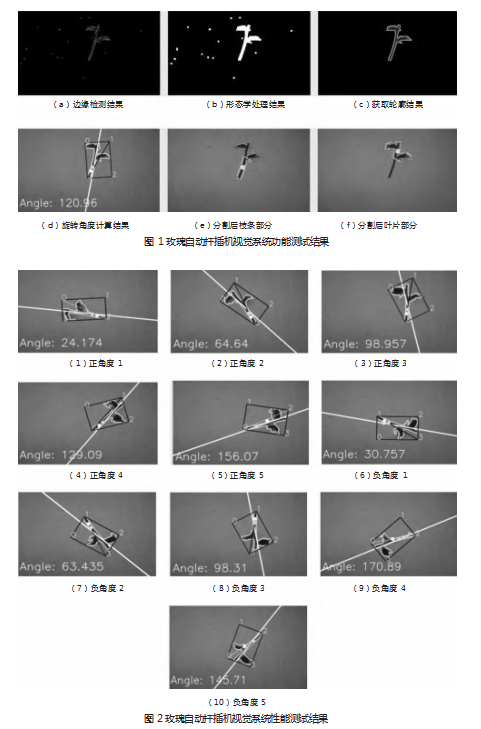

试验采用单个玫瑰插穗来验证图像处理算法的效果,其关键步骤的图像处理结果如图1所示。试验识别到目标插穗1个,插穗的旋转为正方向120.96°,抓取点坐标为(309,200)。

由图1可知,研究设计的图像处理算法可识别玫瑰插穗目标,并计算出机械爪抓取角度和抓取点坐标,基本满足玫瑰自动扦插机的作业需求。

3.2系统性能测试

为验证抓取角度和抓取点坐标的准确性,将试验玫瑰插穗摆放10个不同的角度,其中正角度5个,如图2(1)—(5)所示,负角度5个,如图2(6)—(10)所示。玫瑰自动扦插机视觉系统实时识别插穗的抓取角度和抓取点坐标,并记录结果,同时将拍摄的图像保存下来,利用LabelImg软件手动标注每一张图中枝条的主干中轴线,计算抓取角度作为真实值来衡量系统抓取角度的准确性,并人工确定抓取点的像素位置,计算与系统抓取点之间的欧式距离来衡量系统抓取点选择的有效性。

由图2可知,视觉系统能够识别到不同角度的玫瑰插穗,其轮廓与插穗贴合较准确。经计算,视觉系统测量的抓取角度与人工标注的抓取角度误差在0.71°—2.17°之间,其平均误差为1.5°;视觉系统测量的抓取点坐标与人工标注的抓取点坐标之间的欧氏距离误差在32.21—5.45个像素间,其平均误差为12.18个像素点,换算成实际距离为5.26 mm。因此,研究设计的视觉系统能够满足扦插实际作业的需求。

4.结语

研究设计的玫瑰自动扦插机视觉系统能够自动识别输送带上玫瑰插穗,并计算出机械爪的抓取位置和角度,实现抓取位置的高精度定位,并通过实验验证了其有效性和实用性。研究结果为自动扦插机智能化技术升级应用提供了理论依据和技术支撑。为进一步提高工作效率,后续研究中应进一步加强对多插穗目标的识别算法研究,并与机械臂配合实现全程自动化。

参考文献:

[1]杨涛,张梅,李晓晓,等.川芎苓种扦插装备关键机构运动分析与试验[J].中国农机化学报,2023,44(11):32-37.

[2]王迎辉,孙浩然,解华臻,等.小型树苗扦插机的设计[J].南方农机,2023,54(22):35-37+57.

[3]郑邵秋,张彩虹,王国强.巨菌草扦插机扦插机构优化设计与试验[J].中国农机化学报,2023,44(06):32-41.

[4]鲁晨阳.藜蒿扦插机的设计与试验[D].武汉:华中农业大学,2022.

[5]郑明锋,叶鹏博,唐涛,等.柳条扦插机链板式自动出料装置设计与试验[J].中国农机化学报,2022,43(05):14-21.

[6]郑邵秋.巨菌草扦插机扦插机构的优化设计与试验[D].乌鲁木齐:新疆农业大学,2022.

[7]林旭翔,张凌峰,薛金林.芦蒿自动扦插机的分苗装置设计[J].安徽农业科学,2021,49(02):211-215.

[8]王玉乾.观赏苗木自动扦插机关键部件设计及试验研究[D].沈阳:沈阳农业大学,2018.

[9]苏微,阙煜,赖庆辉,等.康乃馨扦插机器人设计与试验[J].农业工程学报,2024,40(18):1-12.