基于人工智能与 5G 技术的工业机器人智能识别与定位系统设计研究论文

2026-05-11 15:57:56 来源: 作者:xuling

摘要:本研究基于人工智能与5G技术,设计了融合人工智能与5G技术的工业机器人智能识别与定位系统。该系统在实际使用过程中能够凭借多传感器融合技术的优势,实现对位置的精准定位与导航,同时借助5G技术的优势实现远程运作。

摘要:本研究基于人工智能与5G技术,设计了融合人工智能与5G技术的工业机器人智能识别与定位系统。该系统在实际使用过程中能够凭借多传感器融合技术的优势,实现对位置的精准定位与导航,同时借助5G技术的优势实现远程运作。实验数据表明,该系统的识别精准度、定位精度、实施性等均优于传统的机器人系统,可为远程智能制造工作的开展提供解决方案。

关键词:人工智能;5G技术;工业机器人;智能识别;定位系统;设计研究

多传感器数据融合被越来越多地应用于工业机器人,特别是在智能识别和定位等领域具有巨大的应用前景。当前,基于机器视觉的机器人定位技术在一定程度上提升了机器人的环境感知能力。这类技术通过摄像机对工作区进行拍摄,计算机通过图像识别方法提取跟踪特征,进行数据识别和计算,通过逆运动学求解得到机器人各关节位置误差值[1]。然而,这类方法在动态环境下的识别精度和鲁棒性仍有待提高,且单目视觉系统难以获取深度信息,限制了定位精度。近年来,人工智能技术在计算机视觉、深度学习等领域的突破为机器人的智能感知与决策提供了新的解决方案[2]。基于此,本研究意在设计一种依托人工智能与5G技术的工业机器人智能识别和定位系统,提高其智能化水平和作业成效。

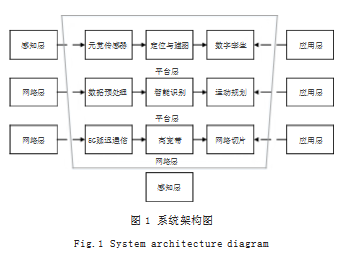

1系统架构设计

1.1感知层

感知层作为系统的基础层级,承担着采集机器人内部状态与外部环境信息的任务,主要由以下组件构成。

(1)视觉传感器。选用双目相机和高分辨率RGB相机形成的混合视觉系统,既可以利用双目视觉得到深度方面的信息,又可凭借高分辨率RGB图像抓取物体细节。双目视觉系统依靠两个相机从不一样的视角拍摄图像,经由视差计算获取三维空间的信息[3]。

(2)激光雷达。采用2D激光雷达实现机器人导航与避障,借助3D激光雷达完成环境三维建模,自主开发的激光SLAM算法与多传感器融合,实现无反光板环境中高精度(±5mm)定位及自主导航。

(3)力觉传感器。安装到机器人的末端执行器,用于检测机器人与环境的接触力,完成柔顺化操控。

(4)位置传感器。含有编码器和惯性测量单元,对机器人各关节位置、速度、加速度开展监测。

1.2网络层

网络层采用5G通信技术,为系统提供高速、低延迟的数据传输服务,5G网络的关键技术参数如下。

(1)低延迟通信。实现端到端延迟控制在50ms以内,符合实时控制需求。(2)高带宽。下行传输速率达1Gbps,上行的传输速度达100Mbps,可实现高清视频数据的传输。(3)网络切片。按照系统各类业务的需求,给出按需定制的虚拟网络,保障关键业务(如运动控制)的服务品质[4]。(4)边缘计算。在网络边缘部署计算节点处理实时性要求极高的任务,减轻云端负载并降低通信延迟。

1.3平台层

平台层作为系统的智能核心,可实现数据处理、算法执行和决策管理等相关功能,主要由以下模块联合组成。

(1)数据预处理模块。对多源传感器数据进行滤波、标定,然后进行融合,改善数据质量及一致性。

(2)智能识别模块。采用深度学习算法实现目标物体的识别、分类与分割,采用如FasterR-CNN和YOLOv5的算法[5],实现检测速度与精度的平衡。(3)定位与建图模块。运用改进后的SLAM算法,添加语义信息,提升动态环境中定位的准确水平;采用剔除动态特征点的方式,依据最小化重投影误差,利用当前帧图像里的静态特征点开展位姿估计。(4)运动规划模块。按照环境地图及任务目标,形成最优的运动轨迹,防止碰撞和奇异点情形。(5)协同控制模块。实现多机器人任务的分派和运动的协同,能实现50台以上机器人同时作业,任务响应时间小于1秒。

1.4应用层

应用层直接以最终用户为对象,给出各类机器人应用相关服务,具体如下。(1)远程监控与运维。采用Web界面或移动App实时监测机器人的状态,凭借深度学习故障预测模型实现核心部件失效前100小时预警。(2)任务编程与调度。基于图形化编程界面,实现机器人任务设置及产线调度的流程简化。(3)数字孪生。依靠5G网络达成物理实体与虚拟模型的同步映射,实现离线仿真以及系统的优化,如图1所示。

2关键模块设计

2.1多传感器感知融合模块

为使机器人在复杂工业场景中实现精准感知,本系统采用多传感器融合的方式,借助视觉、激光、IMU等异类传感器数据的融合,提升环境感知的精准水平和稳固性。

视觉与激光雷达融合采取紧耦合途径,通过提取视觉特征的语义详情及激光雷达的精确几何数据,实现对环境的全方位觉察。视觉与IMU融合采用基于滤波原理的融合算法,借助IMU高频数据补偿视觉在快速运动状态下的跟踪丢失,同时以视觉的绝对观测校正IMU的累积性误差,保证系统在快速运动时依旧能维持稳定的位姿估计。

2.2智能识别模块

智能识别模块采用以深度学习为基础的计算机视觉算法,实现对工业零件的精准辨认与定位。目标检测采用改进的YOLOv5算法,基于COCO数据集的预训练模型,利用工业零件图像数据开展迁移学习。针对工业场景下小目标检测难度大这一问题,采用了特征金字塔结构与注意力机制,提升了小目标检测的有效性,改进后的算法针对工业零件数据集平均精度(mAP)达到96.5%,比原始的YOLOv5算法提升了8.7个百分点。

实例分割以MaskR-CNN模型进行,精确分割出零件的前景部分。为解决分割边缘精准度欠佳的问题,在原先的边界框回归和掩码预测分支以外补加了边缘细化分支,凭借多层感知机对分割边界做优化调整,让分割边界与零件真实轮廓更加贴合。

2.3高精度定位模块

高精度定位模块采取视觉伺服控制与SLAM相联合的技术路线,实现机器人精准定位及导航。视觉伺服控制采用基于位置的方式,采用六自由度垂直关节型喷涂机器人作为载体,通过计算机器人末端实际位置与期望位置的偏差,得出控制指令。

SLAM算法采用语义SLAM技术,以ORB-SLAM2框架为依托,通过引入语义信息改善建图与定位的精度和鲁棒性;剔除动态特征点,依据最小化重投影误差,利用当前帧图像中的静态特征点开展位姿估计,提升机器人在动态环境中的定位精准水平。

定位误差补偿运用支持矢量机回归方法,开发控制系统误差校正模型,对机器人末端在同一个平面定位误差做校正处理。经实验验证,与线性插值、神经网络模型相比,该方法可更有效地提升机器人的视觉定位精准度,满足工业机器人抓取、装配等活动的需求。

3系统测试与结果分析

3.1测试环境构建

测试环境为一个10m×8m的模拟工业车间,包含装配台、物料架以及传送带等典型工业用具。测试系统由装配机器人3台、搬运机器人2台和巡检机器人1台组成,均接入5G专网。机器人装有双目相机、激光雷达以及IMU等传感器。服务器采用Intel XeonGold 6230处理器与NVIDIARTX3080显卡的配置。

3.2识别精度测试结果

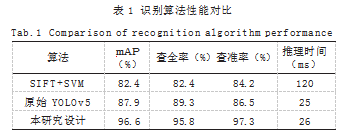

在工业零件检测数据集上进行测试,该数据集包含10种常见的工业生产零件,测试结果如表1所示。

通过表1的数据可以看出,本研究设计的算法在传统数据集上拥有更高的查全率和查准率,尽管推理时间略大于原始YOLOv5,但在实际使用过程中仍能够满足实时性要求。

3.3定位精度测试

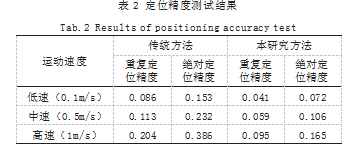

为更好地评估本文方法的定位精度是否符合需求,对不同速度的重复定位精度与绝对定位精度进行比较,结果如表2所示。

通过表2的数据可以看出,在不同运动速度下,本文方法的定位精度显著优于传统方案,尤其是在高速运动的前提下,本文方法的绝对定位精度比传统的方案高出57.5%。

3.4实时性与协同效率测试

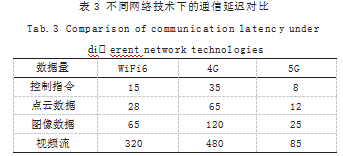

实时性测试重点评估系统在5G网络环境下的通信延迟以及多机器人协同效率。本研究对不同数据量对应的端到端延迟做了测试,且与4G网络和WiFi6进行了对比,结果如表3所示。

表3测试的结果说明,5G网络在所有数据类型下均表现出最低的通信延迟,尤其针对大数据量的视频流传送,5G网络的延迟仅为WiFi6延迟数值的26.5%,为4G的17.7%,体现出其在工业机器人通信中的显著优势。

针对机器人协同的效率,本研究对不同规模机器人集群完成同一任务的时间效率进行了测试。随着机器人数量的增长,本系统的协同效率显著优于传统方法,当机器人数量累计到20台时,本系统完成任务的时间仅为传统方法的42%,展现了基于5G的协同控制算法的显著优势。

4结语

本文设计了一套基于人工智能及5G技术的工业机器人智能识别与定位系统,采用多传感器融合、深度学习算法、高精度定位技术和5G通信技术的有机整合方式,有效解决了传统工业机器人在动态环境下的识别与定位难题。实验数据表明,该系统的识别精准度、定位精度、实时性等均优于传统的机器人系统,可为远程智能制造工作的开展提供解决方案。

参考文献

[1]赵立维.人工智能在工业机器人精准抓取中的应用研究[J].现代制造技术与装备,2025,61(9):173-175.

[2]钟光林.基于智能视觉引导的工业机器人定位识别系统的设计[J].自动化应用,2021(6):78-79+83.

[3]李菁川.基于西门子S7-1200PLC和HSR612(Ⅰ型)工业机器人的智能颜色识别分拣系统的开发[J].武汉职业技术学院学报,2021,20(1):107-111.

[4]蒋思中,白雪.工业机器人目标识别与智能检测技术研究现状与发展趋势[J].轻工科技,2020,36(2):65-66.

[5]耿立明,王迪,杨威.机器视觉在工业机器人智能分拣识别中的研究[J].电子制作,2018(20):32-33.