基于卷积神经网络的语音与面部表情多模态情感识别研究论文

2026-05-11 15:02:54 来源: 作者:xuling

摘要:针对单一语音模态情感识别存在的局限性,本论文提出了一种基于卷积神经网络的语音与面部表情多模态情感识别方法。提取音频时频动态特征与图像表情特征,利用跨模态LXMERT模型实现两者的深度语义融合。

摘要:针对单一语音模态情感识别存在的局限性,本论文提出了一种基于卷积神经网络的语音与面部表情多模态情感识别方法。提取音频时频动态特征与图像表情特征,利用跨模态LXMERT模型实现两者的深度语义融合。系统在构建多模态特征提取框架方面进行了探索,突破了传统融合的表面关联局限。

关键词:卷积神经网络;多模态情感识别;跨模态LXMERT;特征融合

0引言

情感识别是当前人工智能领域的重要研究方向[1],它的核心是通过相关的计算模型对人的情感外显信号进行解析。其研究无论是在理论价值的提升还是满足日益增长的现实需求方面,都成为人工智能服务社会的重要组成部分。

1相关理论

1.1卷积神经网络基础

卷积神经网络是一种面向网格结构数据的深度学习模型,其核心结构由四部分组成:卷积层、池化层、激活函数与全连接层。模型将高层特征展平后映射至输出空间(如分类标签),完成最终决策。

1.2循环卷积网络原理

循环卷积网络是融合卷积神经网络局部特征提取能力与循环神经网络时序建模优势的深度学习模型,专为时空序列数据设计。其核心结构包含卷积层、循环层、激活函数、全连接层。循环卷积网络在视频动作识别、自然语言理解等任务中,通过时空联合表征突破了纯卷积神经网络的性能瓶颈。

1.3跨模态学习与LXMERT模型

跨模态学习是处理多模态数据关联与语义理解的理论框架,目标是通过挖掘模态间互补信息提升任务性能[2]。本课题采用跨模态LXMERT模型处理多模态数据,它可以将图像区域特征、语音时频特征等映射为“视觉/语音Token”[3],通过共注意力机制动态学习模态间交互,实现特征深度融合。

1.4多模态融合策略概述

本课题所采用的融合策略为跨模态LXMERT模型,通过共注意力机制实现语音与图像特征的动态交互,挖掘模态间语义互补性,突破传统融合的表面关联局限,为多模态情感识别提供鲁棒融合方案。

2系统总体设计

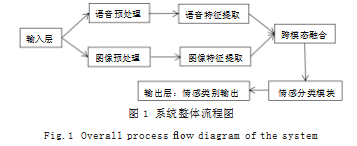

系统整体流程如图1所示。

(1)输入层。输入层的功能是接收原始多模态数据,包括语音信号与人脸图像。数据的输入形式包括语音信号的单通道时序波形与图像信号的RGB三通道静态帧。

(2)预处理模块。语音预处理完成波形数据向时频图的转换,图像预处理则通过MTCNN检测人脸区域并对齐,将图像裁剪后转换为RGB张量。最终该模块将语音时频图与对齐后人脸图像张量作为后续分模态特征提取模块的输入数据。

(3)分模态特征提取模块。本系统的语音特征提取模块将预处理模块输入的时频图经多层卷积后提取时序特征,最终输出128维语音特征向量。图像特征提取模块将预处理输入的对齐图像提取表情特征,最终输出256维图像特征向量。

(4)跨模态融合模块。该模块是系统核心功能模块,实现跨模态特征深度融合,解决模态异质性与语义鸿沟。主要功能是接收分模态特征,输出融合后的统一语义表征,替代传统“特征拼接”的表面关联。

(5)情感分类模块。该功能模块通过2层全连接层以及激活函数实现将融合特征映射至情感类别空间的功能过程,最终生成各情感类别的概率分布。

(6)输出层。根据上面的情感类别的概率分布返回情感分类结果,实现逻辑是取概率最大值对应的类别为最终预测,并输出置信度。

3基于特征相融合的音频情感分析设计实现

3.1音频信号预处理

本研究采用“预加重—分帧—加窗”三级预处理流程优化音频数据质量。

(1)预加重。

本课题中的预加重采用一阶差分滤波器实现,表达式如式(1)所示:

y(n)=x(n)−αx(n−1)(1)

式中,x(n)为原始信号;y(n)为预加重后信号;α为预加重系数。α通常取0.95~0.97(本研究选0.97),兼顾高频提升与低频保留,避免信号失真。

(2)分帧。

语音分帧也被称为语音分段,本系统的分帧采用“交替分段”方式。每一帧的长度一般设定在10~30ms。

(3)加窗。

本系统通过加窗操作实现帧边缘信号的平滑过渡,削弱信号突变对频域分析的干扰。

3.2音频信号的时频特征提取

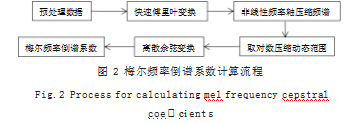

本研究采用短时傅里叶变换与梅尔频率倒谱系数结合的方案,实现从时域信号到情感敏感特征的转化。本系统对每帧施加窗函数并做傅里叶变换,通过滑动窗口形成二维时频矩阵。通过计算梅尔频率倒谱系数表征情感相关的基频、共振峰、能量分布等韵律特征,相关的实现步骤如图2所示。

3.3音频信号的深度特征编码

本研究采用CNN结构,以端到端学习为核心,直接从预处理后的时频信号中提取层级特征,在卷积层捕捉时频局部关联,池化层降维并增强平移不变性,深层网络整合低阶特征形成情感相关的语义表征。最终输出的深度特征向量将作为后续卷积循环神经网络CRNN的卷积层输入。

3.4基于卷积循环神经网络的音频信号特征提取与情感分类

为实现高效准确的音频情感识别,本文采用CRNN模型对音频信号进行特征提取与分类。该模型可输出每段音频的情感类别预测结果,亦可提取循环层末端的隐状态作为高维情感特征向量,供多模态融合系统使用。实验表明,该方法在多种情感语料库上均取得了良好识别效果,验证了其在语音情感分析中的有效性与鲁棒性。

4基于特征相融合的图像情感分析设计实现

图像模态的情感分析功能主要实现人脸图像的预处理、特征提取及情感输出,并重点解决复杂场景下人脸定位偏差、数据多样性不足及特征判别性弱等问题。

4.1人脸图像预处理

人脸图像预处理是情感分析的基础步骤,本系统在设计上采用“检测—对齐—归一化—增强”四步流程。

(1)人脸检测与对齐。

本研究采用多任务级联卷积网络MTCNN作为人脸检测与对齐的核心工具,实现高效的人脸定位与关键点标注,并通过O-Net输出的5个关键点坐标进行标准化对齐。

(2)图像归一化。

为适配深度神经网络的输入要求并提升训练稳定性,需对对齐后的人脸图像进行多维度归一化处理,具体包括尺寸归一化、色彩空间转换、像素值归一化。

4.2基于多任务级联卷积网络MTCNN的人脸特征提取

通过多任务级联卷积网络MTCNN进行图像预处理完成人脸定位与对齐,为人脸情感识别提供标准化输入,但后期的深度情感特征提取需要依赖专门设计的卷积神经网络CNN。

(1)表情特征提取策略。

本课题系统选择轻量级ResNet-18作为特征提取网络,ResNet-18包含8个残差块,通过跳跃连接解决深层网络的梯度消失问题,在保持模型深度的同时提升训练稳定性。

(2)图像模态情感识别输出。

本课题系统的图像模态情感分析输出包含两种形式:情感特征向量与情感类别概率。情感特征向量用于多模态情感识别,情感类别概率输出7类情感的概率分布。

5多模态特征融合与情感决策模块设计实现

经过系列的参考分析,本研究最终选择LXMERT作为跨模态融合的核心模型,解决传统模型在处理本系统所涉及的语音与图像两种异质模态时的语义对齐难题。

5.1输入表示构建

为了适配LXMERT模型,系统需要将之前步骤所获取的音频与图像特征转化为模型可接受的输入形式,具体操作步骤如下:(1)特征投影与token化;(2)完成多模态嵌入。

5.2模态间交互机制

系统通过双向共注意力实现模态交互实现模态融合,主要的流程步骤如下。

(1)单模态编码。语音/图像编码器分别输出上下文特征实现单模态编码Ts(语音)、Tv(图像)。

(2)跨模态注意力计算。

语音→图像:以Ts为查询Tv为键/值,计算注意力权重,生成关注特征Tsv;

图像→语音:以Ts为查询Tv为键/值,计算注意力权重,生成关注特征Tvs。

(3)特征融合。对Ts、Tsv、Ts、Tvs进行拼接,最终融合为跨模态特征Tcross。

(4)特征映射。将跨模态特征映射至情感概率分布,完成情感概率输出。

6结语

本课题通过CRNN提取音频时频动态特征,结合MTCNN+ResNet-18提取图像表情特征,并采用LXM ERT模型通过双向共注意力机制实现模态间动态语义对齐。经实验验证,本文模型在联合测试集上具有较高的识别准确率,较单模态及传统融合方法显著提升。

参考文献

[1]李嘉华,陈景霞,白义民.基于TCN-Bi-GRU和交叉注意Transformer的多模态情感识别[J].陕西科技大学学报,2025,43(1):161-168.

[2]姚懿秦,郭薇.基于交互注意力机制的多模态情感识别算法[J].计算机应用研究,2021,38(6):1689-1693.

[3]YANG J,WEI P,DU X,et al.Graph Attention Based on Contextual Reasoning and Emotion-shift Awareness for Emotion Recognition in Conversations[J].Complex&Intelligent Systems,2025(11):1-20.