多模态虚假新闻检测模型关键技术研究

2026-05-09 10:07:47 来源: 作者:liunanfang

摘要:本研究提出了一种基于双编码器的跨模态假新闻检测模型。

摘 要 :本研究提出了一种基于双编码器的跨模态假新闻检测模型。该模型融合了 ResNet-50 视觉编码器和 BERT 文本编码器, 以实现图文特征的有效对齐 ;引入了基于 KL 散度的跨模态注意力机制与改进的 FGSM 对抗训练方法, 以增强模型的鲁棒性。在 Twitter 数据集上的实验结果表明,该模型能有效识别虚假新闻中的图文不一致特征,在社交媒体内容实时监测方面展现出应用潜力。

关键词 :多模态 ;虚假新闻 ;检测 ;技术

1 相关研究

早期的假新闻检测研究主要采用单模态分析。在文本检测方面, Conroy 等人 [1] 首次提出使用语言学特征和机器学习分类器进行虚假新闻识别。随后引入深度学习模型,利用 CNN 提取文本深层特征。然而,这些单模态方法难以应对日益复杂的多模态伪造手段。

随着多模态学习的兴起,研究者开始探索跨模态特征融合。有研究提出了 MVAE 框架,旨在通过变分自编码器学习图文联合表示。Zhou 等人 [2] 的 SAFE 模型首次引入跨模态相似性度量,但未能充分考虑模态间的不对称关系。最新的 MCAN 模型 [3] 采用多层次注意力机制,在 Weibo 数据集上效果良好。这些方法虽然取得了进展,但在特征对齐和鲁棒性方面仍存在局限。

对比学习近年来在多模态表示学习中展现出了强大潜力。CLIP 模型 [4] 通过海量图文对预训练,实现了卓越的零样本迁移能力。ALBEF 进一步引入动量蒸馏,缓解了数据噪声问题。在假新闻检测领域, Wei 等人首次尝试将对比学习应用于跨模态伪造检测,但其采用的固定温度参数限制了模型性能。Chen 等人提出的CAFE 模型通过跨模态模糊性学习,为注意力机制设计提供了重要启示。

对抗训练已被证明能有效提升模型鲁棒性。Good fellow 等人提出的 FGSM 算法为本文的对抗样本生成提供了基础。Zhang 等人在 EANN 中首次将对抗训练引入假新闻检测,但仅用于事件无关特征提取。本文的创新之处在于将动态对抗训练与多模态相结合,逐步提升模型防御能力。

2 算法原理

2.1 模型算法原理

本文首先使用模态特定编码器,视觉编码器使用预训练的 ResNet 提取图像的区域特征,并通过全连接层生成视觉嵌入向量 e0 ;文本编码器使用 BERT 模型提取文本的上下文表示,并通过全连接层生成文本嵌入向量et,用于实现原始图像和文本数据转换为高维特征表示。关键算法主要有三部分。

(1)跨模态对比学习模块。

一致性学习 :构建新的数据集 D',标记图像—文本对是否匹配(正样本或负样本) ; 通过模态特定的多层感知机(MLP)将嵌入向量投影到共享语义空间,计算余弦相似度损失 LITM。

对比学习 :计算图像到文本和文本到图像的相似度矩阵,使用交叉熵损失 LITC。

软目标机制 :利用一致性学习生成的语义相似度矩阵作为软目标,计算语义匹配损失 LSEM,优化对比学习过程。

计算总损失 :LCL = LITC + λLSEM 。

(2)跨模态融合模块。

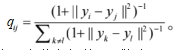

主要步骤如下 :计算模态间的注意力权重 ;更新原始嵌入向量,生成显式相关性特征 mfo 和 mft ;通过外积操作生成交互矩阵 mf,并将其展平为向量。

(3)跨模态聚合模块。

注意力机制 :将对齐的单模态特征 mo、mt 和融合特征 m f 拼接,通过全局平均池化和门控机制生成注意力权重a = {ao , at , af }。

注意力引导 :使用变分自编码器(VAE)建模单模态特征的潜在分布,计算 KL 散度作为跨模态模糊性分数 gi ;通过损失函数 LAG 引导注意力权重与模糊性分数对齐,提升可解释性。

分类器 :加权聚合特征,通过全连接网络和 Softmax预测标签。

计算总损失 :LCA = LCLS + γ LAG。

2.2 测试算法原理

CLIP 模型 :进行图像编码和文本编码,提取图像和文本的跨模态特征。

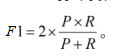

(1)测评 Precision(P)、Recall(R)、F1 指标。

混淆矩阵 :C

精确率 Precision :  用于衡量模型预测正例的准确性。

用于衡量模型预测正例的准确性。

召回率 Recall : 衡量模型的泛化能力。

衡量模型的泛化能力。

F1-Score :

(2)t-SNE 降维。

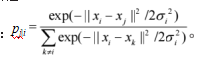

t-SNE (t-Distributed Stochastic Neighbor Embedding) 是一种非线性降维技术,特别适用于高维数据的可视化。其核心思想是通过概率分布来保持高维和低维空间的局部相似性。

高维空间相似度 :

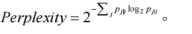

式中, σi 是通过困惑度调节的参数 :

低维空间相似度 :

损失函数 :最小化两个分布间的 KL 散度 :

随后进行梯度更新。

随后进行梯度更新。

3 模型实现

3.1 模型算法实现

(1)数据预处理。

用 FastCNN 处理文本, 提取局部语义特征, 使用全连接网络处理图像特征。

prepare_data 函数为相似性任务构造匹配 / 不匹配的图像—文本对,生成匹配对(fixed_text, matched_ image)和不匹配对(fixed_text, unmatched_image,通过 roll 随机打乱);get_soft_label 函数对真实新闻(label=0)生成独热编码, 对假新闻(label=1)生成均匀分布。

(2)模型架构。

CLIP 模块 CLIP(64) :实现跨模态特征对齐,输出 64维对齐的跨模态特征(image_aligned,text_aligned)。

相似性模块 SimilarityModule :实现图文相似性判断,通过 EncodingPart 获取基础特征,使用独立的对齐网络(text_aligner 和 image_aligner)将特征映射到 64 维空间, 输出相似性分数(pred_similarity)和对齐后的特征(text_aligned, image_aligned)。

检测模块 DetectionModule :实现假新闻分类, 核心有三部分, AmbiguityLearning 计算图文模态的 KL散度, 量化模态模糊性, CrossModule4Batch 计算跨模态相关性, SENet 动态调整各模态特征的权重。实现过程 :编码原始图文特征以获取 text_prime 和 image_ prime, 计算跨模态相关性 correlation, 输出假新闻分类概率(pre_detection)、注意力分数(attention_ score)和 KL 散度分数(skl_score)。

(3)损失函数。

损失函数 CosineEmbeddingLoss 计算余弦相似度损失 :loss_func_similarity(text_aligned, image_aligned, similarity_label_1), 拉近匹配图文对的余弦相似度,推远不匹配对。

对比损失 CrossEntropyLoss 计算交叉熵损失 :

loss_clip_i = loss_func_clip(logits, labels) # 图像到文本

loss_clip_t = loss_func_clip(logits.T, labels) #文本到图像

通过 soft_loss(KL 散度)结合相似性模块的输出作为软标签。

分类损失 CrossEntropyLoss :loss_detection = loss_ func_detection(pre_detection, label)。

KL 散度损失 :loss_func_skl(attention_score, skl_ score),约束注意力分数与模态模糊性分数的一致性。

3.2 测试算法实现

(1)指标计算。

手动计算各指标 :

def manual_prf1(conf_matrix): precision = TP / (TP + FP) if (TP + FP) > 0 else 0 recall = TP / (TP + FN) if (TP + FN) > 0 else 0

f1 = 2 * (precision * recall) / (precision + recall) if

(precision + recall) > 0 else 0

return precision, recall, f1

工具包计算使用 sklearn.metrics, 随后通过断言检查手动计算与工具包结果是否一致。

(2)t-SNE 可视化。

提取特征 :模型返 回三元组 (predictions, last_ hidden_features, aux_data), 精确获取分类决策前的特征层。

降维 :from sklearn.manifold import TSNE

tsne = TSNE( n_components=2, perplexity= min(30, len(features)//4),early_exaggeration=12, learning_ rate=200, random_state=42, n_iter=1500, metric=’cosine’)

其中, perplexity :根据数据量动态调整, 保证5-50 的有效范围 ;early_exaggeration :初期放大类间距离 ;learning_rate :避免陷入局部最优。

3.3 结果及分析

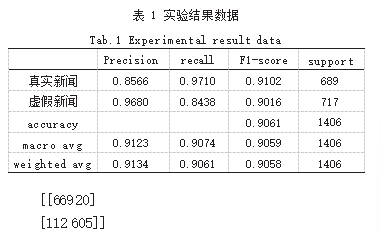

实验结果数据如表 1 所示,可以看出,虚假新闻的精确率(0.968)极高,说明模型预测为“假”的样本中,96.8% 确实为假, 召回率(0.844)较低, 约 15.6%的假新闻未被识别(FN=112);真实新闻的精确率(0.857)较低,存在部分真实新闻被误判为假(FP=20),召回率(0.971)极高,说明模型能有效捕捉真实新闻(漏检率仅 2.9%)。两类别的 F1 均超过 0.9,表明模型在精确率和召回率间取得了较好平衡。

混淆矩阵为 :

模型适合高精度场景,如避免误删真实内容。模型整体准确率和 F1-Score 表现优秀,但仍存在可优化空间,如捡漏假新闻较多,可能导致真实内容被过滤。可在提升假新闻召回率、减少真实新闻误判等方面做更多优化。

4 结语

该跨模态假新闻检测模型在测试集上表现优异,综合准确率达到 90.61%, 且两类别的 F1-Score 均超过0.9,表明模型在多模态特征对齐和分类任务上具有较强能力。实验结果表明,跨模态对比学习能有效缩小图像和文本特征间的语义鸿沟,为假新闻检测提供更具判别性的特征表示 ;引入的软标签机制通过减轻传统对比学习中负样本的过度惩罚,显著提升了模型在同类事件新闻中的泛化能力 ;注意力引导模块不仅提升了性能,还增强了决策过程的可解释性。本研究为跨模态假新闻检测提供了新的技术思路,在社交媒体内容审核等实际应用场景中具有重要价值。

参考文献

[1] CONROY K N,RUBIN L V,CHEN Y.Automatic Deception Detection: Methods for Finding Fake News[J]. Proceedings of the Association for Information Science and Technology,2015,52(1):1-4.

[2] ZHOU X,WU J,ZAfARANI R.SAFE:Similarity-aware Multi-modal Fake News Detection[C]//Proceedings of PAKDD,2020:354-367.

[3] WU Y,ZHAN P,ZHANG Y,et al.Multimodal Fusion with Co-attention Networks for Fake News Detection[C]// Proceedings of the Association for Computational Linguistics,2021:2560-2569.

[4] RADFORD A,KIM J W,HALLACY C.Learning Transferable Visual Models from Natural Language Supervision[J].International Conference on Machine Learning,2021:8748-8763.