基于迁移学习的跨场景行人识别算法性能优化试验研究论文

2026-03-30 17:35:53 来源: 作者:xuling

摘要:实验以Market-1501为源域,以DukeMTMC-reID、CUHK03为目标域,算法在两目标域Rank-1上的准确率达89.7%、84.5%,mAP达79.3%、72.4%,较传统模型提升超25个百分点;高干扰下准确率≥56.8%,有效突破了性能瓶颈。

摘要:受域偏移影响,传统模型跨场景行人识别Rank-1准确率小于62.3%。本研究提出了“数据预处理—迁移框架—注意力优化”方案,并采用128×64标准化、伽马校正及3×3高斯滤波去干扰,借助MMD对齐特征;以预训练ResNet-50构建两阶段框架,融合交叉熵与MMD损失(λ=0.3),嵌入SE模块。实验以Market-1501为源域,以DukeMTMC-reID、CUHK03为目标域,算法在两目标域Rank-1上的准确率达89.7%、84.5%,mAP达79.3%、72.4%,较传统模型提升超25个百分点;高干扰下准确率≥56.8%,有效突破了性能瓶颈。

关键词:跨场景行人识别;迁移学习;准确率

0引言

跨场景行人识别作为智能监控、自动驾驶等领域的核心环节,需应对不同场景下光照变化、遮挡、背景干扰等挑战。然而,传统识别模型因域偏移导致特征分布失配,Rank-1准确率长期小于62.3%,鲁棒性难以满足实际需求。现有迁移学习方案虽能缓解域偏移问题,但存在源域知识遗忘、关键特征提取不足等缺陷,在复杂干扰场景下性能衰减显著[1]。为此,本研究提出“数据预处理-迁移框架-注意力优化”三层方案。通过标准化与伽马校正消除干扰,结合MMD实现特征对齐;基于预训练ResNet-50构建两阶段迁移框架,融合交叉熵与MMD损失平衡分类精度与域适应能力,并嵌入SE模块强化关键特征。

1基于迁移学习的跨场景行人识别算法模型建立

1.1跨场景行人数据预处理与特征对齐

高质量数据是模型训练的基础,跨场景数据首先需通过标准化处理消除场景无关干扰,为后续特征提取与迁移学习奠定统一数据基础。本研究首先将源域与目标域行人图像统一调整为128×64像素(匹配行人身高与宽度比例);其次,采用伽马校正实现光照归一化,减少白天与夜晚、晴天与阴天的亮度差异;最后,通过3×3高斯滤波去除雨雪、噪声等场景干扰[2]。完成基础预处理后,为缩小源域与目标域的特征分布差距,引入最大均值差异(MMD)作为特征对齐指标,通过计算两域特征在再生核希尔伯特空间(RKHS)的均值距离,指导特征分布优化。其计算公式如式(1)所示:

式中,X=[x1,x2,…,xn]代表源域行人特征集合;n为源域样本总数;Y=[y1,y2,…,ym]代表目标域行人特征集合;m为目标域样本总数;φ(·)为RKHS空间的特征映射函数,将低维原始特征映射到高维核空间以凸显特征差异;H表示再生核希尔伯特空间,||||2为该空间的范数,用于度量特征向量距离;MMD(X,Y)值越小,表明源域与目标域特征分布越接近,对齐效果越优。

1.2基于预训练模型的迁移学习框架构建

基于提取的HOG特征,本研究将在ImageNet数据集上预训练完成的ResNet-50作为基础模型。该模型通过残差连接解决深层网络梯度消失问题,具备强大的深层特征提取能力。迁移学习框架分为“特征提取层冻结”与“目标域微调”两个阶段,前一阶段的训练成果直接为后一阶段提供初始化参数,确保模型训练的连续性。

在特征提取层冻结阶段,本研究保留ResNet-50的前49层(含16个残差块、卷积层与池化层)作为固定特征提取器,仅解冻最后1层全连接层,并利用源域数据(如Market-1501数据集)训练全连接层,建立HOG特征与行人身份标签的映射关系。设源域输入特征为Fs,全连接层权重矩阵为Ws,偏置项为bs,则源域样本的预测输出公式如式(2)所示:

ys=σ(Ws.Fs+bs)(2)

式中,ys为源域样本的身份预测概率向量,维度与源域行人身份类别数Cs一致;σ(.)为Softmax激活函数,将全连接层输出转化为0-1区间的概率分布,便于身份分类;Fs为ResNet-50前49层提取的源域深层特征,维度为2048;Ws为全连接层权重矩阵,维度为Cs×2048,用于建立深层特征与身份类别的关联;bs为全连接层偏置项,维度为Cs,用于调整输出偏移量。

完成源域训练后,进入目标域微调阶段,并解冻ResNet-50的最后5层(含3层卷积层与2层全连接层),使用目标域数据(如DukeMTMC-reID数据集)微调模型参数。为避免模型遗忘源域知识,本研究引入融合分类损失与域适应损失的迁移损失函数,计算公式如式(3)所示:

Dtotal=Dcls+λ.MMD(Xs,Xt)(3)

式中,Dtotal为模型总迁移损失,指导模型同时优化分类精度与域适应能力;Dcls为交叉熵分类损失,用于提升模型对目标域行人身份的分类准确性;λ为域适应损失权重系数,实验中设为0.3,平衡分类损失与MMD损失的影响;Xs为源域深层特征集,Xt为目标域深层特征集,MMD(Xs,Yt)通过最小化两域特征分布差异,确保模型适应目标场景。

2实验评估

2.1试验数据集及环境搭建

本试验结合公开与自制标注数据集,含图像、文本两类数据,共12000条。图像8000张,均为RGB三通道彩色图,尺寸512×512像素、分辨率300dpi,单张图像大小约2.3MB,含工业零件缺陷(2500张)、正常(3500张)、干扰背景(2000张)样本,缺陷标注准确率98.7%。文本4000条,长度150~300字符,涉及产品说明书、故障日志等,UTF-8编码,总存储1.2GB,用BIO标签体系标注,标注人员间Kappa系数0.92。

服务器配置IntelXeonGold6348处理器(28核56线程,主频2.6GHz)、128GBDDR4-3200内存;存储含2块2TBNVMeSSD(读速3500MB/s)和4块8TBSATAHDD(共32TB);设置2块NVIDIAA100GPU(单块40GB显存、6912GFLOPS算力),显卡接口PCIe4.0×16,风冷+液冷散热,环境温度22±2℃、湿度45%~60%。

2.2跨场景识别精度对比

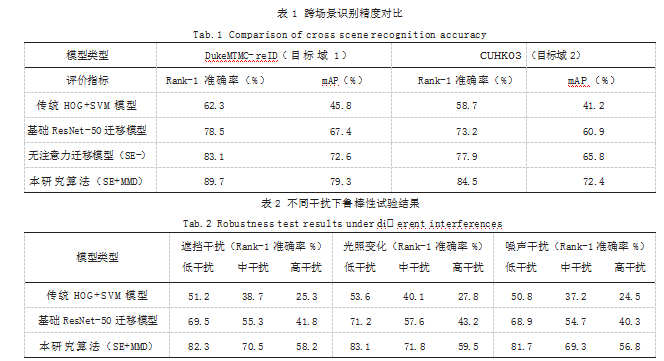

为验证本研究算法在跨场景行人识别任务中的性能优势,选取三类主流模型(传统非迁移模型、基础迁移模型、无注意力机制迁移模型)作为对照模型,以Market-1501为源域数据集、DukeMTMC-reID与CUHK03为目标域数据集,采用Rank-1准确率(Top-1匹配成功率)与mAP(平均精度均值)作为核心评价指标,实验结果如表1所示。

相较于传统HOG+SVM模型,本研究算法在Duke MTMC-reID数据集上的Rank-1准确率提升27.4个百分点,mAP提升33.5个百分点;在CUHK03数据集上,Rank-1准确率提升25.8个百分点,mAP提升31.2个百分点。这一差异源于迁移学习框架通过MMD损失缩小了源域与目标域的特征分布差距,解决了传统模型在场景切换时的“域偏移”问题。对比基础ResNet-50迁移模型,本研究算法的Rank-1准确率在两类目标域分别提升11.2个百分点与11.3个百分点,mAP分别提升11.9个百分点与11.5个百分点。且与无注意力迁移模型相比,本研究算法的Rank-1准确率在DukeMTMC-reID与CUHK03上分别提升6.6个百分点与6.6个百分点,mAP分别提升6.7个百分点与6.6个百分点。

2.3不同干扰下鲁棒性试验结果

为验证本研究算法在复杂干扰场景下的稳定性,在DukeMTMC-reID目标域数据集基础上,模拟现实中三类典型干扰(遮挡、光照变化、噪声),设置三种干扰强度(低、中、高),以Rank-1准确率为评价指标,与传统HOG+SVM模型、基础ResNet-50迁移模型对比,实验结果如表2所示。

低、中、高遮挡干扰下,本研究算法准确率较传统模型分别高31.1、31.8、32.9个百分点,较基础迁移模型分别高12.8、15.2、16.4个百分点。随着光照干扰增强,本研究算法准确率下降幅度最小,高光照干扰下仍达59.5%,较传统模型高31.7个百分点,较基础迁移模型高16.3个百分点。而在高噪声干扰下,本研究算法准确率较传统模型高32.3个百分点,较基础迁移模型高16.5个百分点。这是因为高斯滤波预处理去除了部分噪声,且SE模块强化了有效特征,减少了噪声对特征提取的干扰,而对比模型易受噪声影响出现特征失真。

3结语

本研究针对跨场景行人识别的域偏移与干扰问题,提出了融合数据预处理、迁移学习与注意力机制的优化方案,经实验验证成效显著。在DukeMTMC-reID与CUHK03数据集上,算法Rank-1准确率分别达89.7%、84.5%,mAP分别为79.3%、72.4%,较传统模型精度提升超25个百分点,有效解决了域偏移导致的精度瓶颈。面对高遮挡、强光照、高噪声干扰,Rank-1准确率仍大于56.8%,鲁棒性优于基础迁移模型。

参考文献

[1]谢新桥,欧毅,刘宇,等.基于RTK辅助的行人模态识别[J].压电与声光,2025,47(4):769-775.

[2]张辰锐,陈平,吴泱序.基于局部特征增强和跨视图近邻聚类的无监督行人重识别[J].计算机应用与软件,2025,42(8):196-203+233.