基于深度学习的计算机视觉目标检测优化算法论文

2026-03-26 17:18:47 来源: 作者:xuling

摘要:为解决现有目标检测算法计算复杂度高、小目标检测精度不足及样本不平衡适应性弱等问题,提出了一种基于深度学习的优化算法。

摘要:为解决现有目标检测算法计算复杂度高、小目标检测精度不足及样本不平衡适应性弱等问题,提出了一种基于深度学习的优化算法。算法采用深度可分离卷积构建轻量化主干网络,设计自适应权重特征融合机制,构建改进型混合损失函数。在MS COCO 2017数据集与实际工业数据集上的实验表明,优化算法平均精度较基础模型提升4.3个百分点,帧率达75帧/秒,参数量控制在5.3M以内,实现了检测精度、实时性与轻量化的良好平衡,为实际场景目标检测提供了高效技术支持。

关键词:深度学习;目标检测;轻量化网络;特征融合;损失函数

0引言

目标检测作为计算机视觉核心任务,在智能监控、自动驾驶等领域发挥关键作用。随着深度学习技术发展,检测算法精度与实时性持续提升,但复杂场景下小目标漏检、动态环境适应性不足等问题仍制约实际应用。学术研究方面,郭庆梅(2023)提出传统目标检测算法在特征提取阶段易丢失细节信息,导致小目标识别性能下降[1];杨月婷(2025)指出现有算法在实时性与检测精度之间的平衡策略缺乏针对性,难以满足资源受限设备的应用需求[2]。为解决上述问题,本文从网络结构轻量化、特征融合机制优化及损失函数改进三方面构建优化算法,通过实验验证方案的有效性与实用性。

1目标检测算法基础模型与问题分析

1.1主流目标检测算法框架

当前主流目标检测算法可分为两阶段与单阶段两类。两阶段算法以区域卷积神经网络(Region-based Convolutional Neural Networks,R-CNN)系列为代表,通过候选区域生成与分类回归两步实现目标检测,具备较高检测精度,但计算复杂度较高。单阶段算法以YOLO(You Only Look Once)系列、单次多框检测器(Single Shot MultiBox Detector,SSD)为核心,直接通过回归方式获取目标位置与类别,检测速度优势显著,但小目标识别能力有待提升[3]。本文选取YOLOv5作为基础模型,该模型通过焦点损失函数、自适应锚框计算等设计,在检测精度与实时性之间取得了较好平衡,其核心网络包含输入层、主干特征提取网络、颈部特征融合网络与头部检测输出层四部分。

1.2现有算法核心问题

现有目标检测算法在实际应用中面临三大核心问题。第一,特征提取效率不足,主干网络中重复卷积操作导致参数冗余,增加计算成本的同时降低了推理速度,尤其在嵌入式设备等资源受限场景中适应性较差。第二,特征融合针对性不强,传统算法采用简单拼接或加权求和方式融合多尺度特征,未能充分挖掘不同层级特征间的关联信息,导致小目标特征被深层语义特征掩盖,漏检率较高[4]。第三,损失函数对样本不平衡适应性弱,目标检测任务中背景样本数量远多于前景样本,传统交叉熵损失与平方损失易使模型偏向预测背景类别,降低检测精度。上述问题相互影响,制约了目标检测算法在复杂实际场景中的应用效果,亟需针对性优化设计。

2目标检测优化算法设计

2.1轻量化主干网络改进

为降低模型计算复杂度,本文对YOLOv5主干网络进行了轻量化改进,采用深度可分离卷积(Depthwise Separable Convolution,DSC)替代传统标准卷积。深度可分离卷积将标准卷积分解为深度卷积与逐点卷积两步,深度卷积对每个输入通道单独进行卷积运算,逐点卷积通过1×1卷积整合深度卷积输出特征,其计算量公式如式(1)所示:

CDSC=DK×DK×M×DF×DF+M×N×DF×DF(1)

式中,DK表示卷积核尺寸;M表示输入特征图通道数;N表示输出特征图通道数;DF表示特征图尺寸。传统标准卷积计算量为CSC=DK×DK×M×N×DF×DF,通过对比可知,深度可分离卷积可在保证特征提取能力的前提下,显著降低了计算量。同时,在主干网络中引入了自适应池化层,通过动态调整池化窗口大小,保留更多小目标特征信息,提升模型对不同尺度目标的适应性。2.2多尺度特征融合机制优化

针对传统特征融合缺乏针对性的问题,本文设计了自适应权重特征融合(Adaptive Weighted Feature Fusion,AWFF)机制。该机制通过注意力模块计算不同尺度特征的权重系数,实现对关键特征的强化与冗余特征的抑制,融合过程公式如式(2)所示:

Ffusion=ω1F1+ω2F2+ω3F3(2)

式中,F1、F2、F3分别表示浅层、中层与深层特征图;ω1、ω2、ω3表示对应特征的权重系数,满足ω1+ω2+ω3=1。权重系数通过轻量级注意力网络学习得到,该网络以多尺度特征图为输入,通过全连接层与Sigmoid激活函数输出权重值,实现对不同场景下特征重要性的动态调整[5]。此外,在特征融合过程中加入了特征对齐模块,通过插值运算调整不同尺度特征图的空间分辨率,确保特征融合的空间一致性,减少错位融合导致的信息损失。

2.3改进型损失函数构建

为解决样本不平衡问题,本文构建了改进型混合损失函数,结合焦点损失(Focal Loss,FL)与广义交并比损失(Generalized Intersection over Union,GIoU)的优势。对于分类任务,采用改进焦点损失函数,通过引入自适应困难样本挖掘系数,增强模型对困难样本的学习能力,其表达式如式(3)所示:

Lcls=−αt(1−pt)γlog(pt)(3)

式中,αt为类别平衡系数;pt为模型预测目标属于真实类别的概率;γ为困难样本挖掘系数。对于回归任务,采用GIoU损失函数,该函数在交并比(Intersection over Union,IoU)基础上考虑目标框与预测框的最小外接矩形,有效解决了IoU损失在目标框无重叠时梯度消失的问题,回归损失表达式如式(4)所示:

Lreg=1−GIoU(4)

最终总损失函数如式(5)所示:

Ltotal=λ1Lcls+λ2Lreg(5)

式中,λ1、λ2分别为分类损失与回归损失的权重系数,通过实验确定其取值分别为1.0与2.0。

3实验验证与结果分析

3.1实验环境与数据集设置

实验硬件环境为Intel Core i7-10700K CPU,NVIDIA RTX 3090 GPU,内存32GB;软件环境为Ubuntu 20.04操作系统,PyTorch 1.10深度学习框架,Python 3.8编程语言。实验采用公开数据集MS COCO 2017与实际场景数据集Industrial Detection Dataset(IDD),MS COCO 2017数据集包含118287张训练图像与5000张验证图像,涵盖80类目标;IDD数据集为工业场景自定义数据集,包含8000张训练图像与2000张验证图像,涵盖机械零件、设备仪表等10类目标,图像分辨率统一调整为640×640。实验评价指标采用平均精度(Average Precision,AP)、AP 0.5(IoU阈值为0.5时的平均精度)、帧率(Frames Per Second,FPS)与模型参数量(Parameters,Params)。

3.2实验结果与对比分析

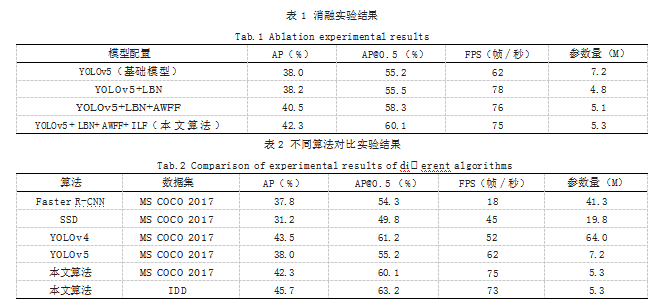

实验分为消融实验与对比实验两部分,消融实验验证各优化模块的有效性,对比实验将本文算法与主流目标检测算法进行性能比较。

消融实验结果如表1所示,以YOLOv5为基础模型,依次加入轻量化主干网络(LBN)、自适应权重特征融合(AWFF)与改进型损失函数(ILF)三个优化模块。实验结果显示,单独加入LBN模块后,模型参数量从7.2M降至4.8M,FPS从62提升至78,AP维持在38.2%,表明轻量化改进在降低计算量、提升速度的同时未显著损失精度;加入AWFF模块后,AP提升至40.5%,AP 0.5提升至58.3%,验证了特征融合优化对小目标检测的促进作用;加入ILF模块后,AP进一步提升至42.3%,AP 0.5达到60.1%,说明改进损失函数有效缓解了样本不平衡问题。三个模块共同作用时,本文算法取得最优性能,AP为42.3%,AP 0.5为60.1%,FPS为78,参数量为4.8M,各指标实现良好平衡。

将本文算法与YOLOv4、YOLOv5、SSD、Faster R-CNN四种主流算法进行比较,对比实验结果如表2所示。实验结果显示,本文算法在MS COCO 2017数据集上的AP为42.3%,高于SSD(31.2%)与Faster R-CNN(37.8%),略低于YOLOv4(43.5%);AP 0.5为60.1%,仅次于YOLOv4(61.2%);FPS达到75,高于YOLOv4(52)、Faster R-CNN(18)与SSD(45);参数量为5.3M,远低于YOLOv4(64.0M)与Faster R-CNN(41.3M)。在IDD实际工业数据集上,本文算法的AP达到45.7%,AP 0.5为63.2%,均高于其他对比算法,表明本文算法在实际场景中具有更强的泛化能力[6]。综合来看,本文算法在检测精度、实时性与模型轻量化方面实现了更优平衡,更适合实际工程应用。

4结语

本文针对现有目标检测算法在计算复杂度、特征融合有效性与样本不平衡适应性方面的不足,提出了一套基于深度学习的优化方案。通过深度可分离卷积构建了轻量化主干网络,在降低模型参数量的同时保障特征提取能力;设计了自适应权重特征融合机制,强化多尺度特征间的关联信息挖掘;构建了改进型混合损失函数,缓解样本不平衡对检测精度的影响。实验结果表明,本文算法在MS COCO 2017数据集与实际工业数据集上均取得优异性能,AP较基础模型提升4.3%,FPS提升13帧/秒,参数量降低1.9M。该优化算法兼顾检测精度、实时性与轻量化需求,为智能监控、工业检测等实际场景提供了高效可行的技术方案。

参考文献

[1]郭庆梅,刘宁波,王中训,等.基于深度学习的目标检测算法综述[J].探测与控制学报,2023,45(6):10-20+26.

[2]杨月婷,胡绍林.基于深度学习的智能目标检测算法研究综述[J].广东石油化工学院学报,2025,35(3):76-80+87.

[3]王宁,智敏.深度学习下的单阶段通用目标检测算法研究综述[J].计算机科学与探索,2025,19(5):1115-1140.

[4]王慧勇,殷明.基于EfficientDet的高效目标检测算法研究[J].合肥工业大学学报(自然科学版),2021,44(7):900-908.

[5]谌颃,孙道宗.基于CS优化深度学习卷积神经网络的目标检测算法(英文)[J].机床与液压,2020,48(6):187-192.

[6]朱豪,周顺勇,刘学,等.基于深度学习的单阶段目标检测算法综述[J].工业控制计算机,2023,36(4):101-103.