基于人工智能的计算机辅助数字媒体艺术创作论文

2026-03-26 16:58:03 来源: 作者:xuling

摘要:随着人工智能技术的快速迭代,其在数字媒体艺术创作领域的应用已从辅助工具升级为核心创作伙伴,推动数字媒体艺术形成“人机协同”的新范式。

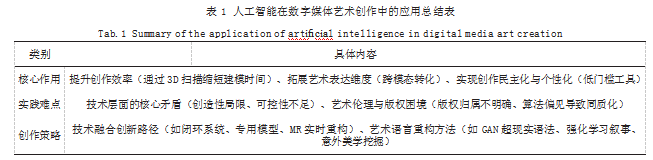

摘要:随着人工智能技术的快速迭代,其在数字媒体艺术创作领域的应用已从辅助工具升级为核心创作伙伴,推动数字媒体艺术形成“人机协同”的新范式。本文以人工智能辅助数字媒体艺术创作的实践为核心,结合3D扫描建模技术的应用场景,系统地分析人工智能的核心作用与问题,并从技术融合创新路径、艺术语言重构与技术落地协同方法两个维度,提出了“人类引导—AI生成—反馈优化”闭环系统、领域专用模型开发、MR实时AI场景重构以及基于对抗生成网络的超现实视觉语法探索等具体策略,为数字媒体艺术的可持续发展提供了新路径。

关键词:人工智能;计算机辅助;数字媒体艺术

0引言

数字媒体艺术作为技术与艺术交叉融合的产物,其发展始终与技术革新紧密关联。从早期的计算机图形技术到如今的人工智能技术,计算机始终是技术落地的核心支撑,每一次技术突破都推动了数字媒体艺术创作形态与逻辑的重构。本文基于人工智能与数字媒体艺术创作的融合实践,结合3D扫描建模的应用场景,系统地分析人工智能在数字媒体艺术创作中的核心作用、实践难点,并提出针对性的创作策略,旨在为数字媒体艺术创作者提供理论参考,推动人工智能技术在数字媒体艺术领域的规范化、创新化应用。

1人工智能在数字媒体艺术创作中的核心作用

1.1提升创作效率

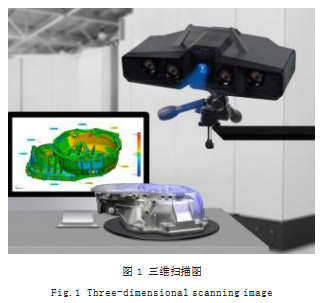

传统数字媒体艺术创作中,3D建模、纹理绘制、场景渲染等环节均需创作者手动操作,且流程复杂。以3D角色建模为例,3D扫描设备获取的点云数据需导入计算机,通过计算机集成的专用处理软件,运行迭代最近点(ICP)算法与正态分布变换(NDT)算法实现点云配准,快速将物理空间信息转化为标准化数字模型,避免从零构建的繁琐过程,显著缩短了创作周期(如图1所示)。例如,在影视数字媒体艺术创作中,工作人员通过3D扫描仪对演员面部进行扫描,获取高精度的面部点云数据,仅需1~2小时即可完成传统建模需数天才能完成的工作。

1.2拓展艺术表达维度

数字媒体艺术的核心价值在于通过数字技术表达人类的情感与思想,而人工智能算法与计算机硬件的协同打破了人类认知与技术能力的限制,拓展了艺术表达的维度。传统数字媒体艺术创作中,创作者的想象力往往受限于自身对现实世界的认知,而3D扫描可将现实中存在的复杂结构转化为数字数据,人工智能则可通过算法对这些数据进行重构与变形,生成超越人类认知的艺术形态。

2人工智能在数字媒体艺术创作中应用的问题

人工智能与计算机协同辅助数字媒体艺术创作的技术落地环节仍面临多重核心技术瓶颈。不同品牌3D扫描设备输出的点云、网格数据在精度与格式规范上存在差异,计算机对多格式数据的兼容解析能力不足,导致AI模型调用数据时需额外适配计算机系统接口,易出现细节扭曲或特征丢失;数字媒体艺术细分领域标注数据较为稀缺,传统监督学习模式下的专用模型泛化能力较弱,难以适配小众创作场景的个性化需求;MR实时重构中,计算机的算力分配矛盾突出,轻量级AI模型虽能满足低延迟要求,但生成效果的纹理细节与光影层次感会明显衰减,目前尚未形成在有限算力下兼顾二者的成熟方案。

3人工智能时代的数字媒体艺术创作策略

3.1技术融合创新路径

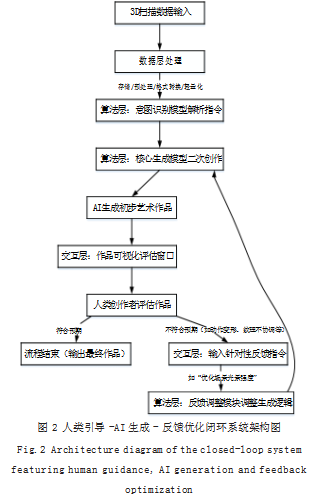

3.1.1构建“人类引导—AI生成—反馈优化”的闭环系统以3D扫描数据为核心支撑的“人类引导—AI生成—反馈优化”系统,其核心运作逻辑在于借助人类创作者的引导与多轮反馈,逐步提升人工智能生成艺术作品过程的可控性与创新性[1](如图2所示)。该系统采用“数据层—算法层—交互层”三级软件架构设计,数据层负责3D扫描数据的存储、预处理与格式转换,集成点云重采样与模型轻量化算法,确保数据既能保留关键细节,又能降低AI计算负荷;算法层包含意图识别模型、核心生成模型与反馈调整模块,实现从指令解析到作品生成的全流程算法支撑;交互层提供自然语言输入界面与作品可视化评估窗口,保障人类创作者与系统的高效交互。

在AI模型输出初步艺术作品后,人类创作者需要对这一版本的作品进行全面且细致的评估,评估过程中若发现作品存在细节不符合预设预期的问题,例如角色动作出现变形、场景纹理呈现不协调等,人类创作者需及时向AI模型输入针对性的反馈指令,这类反馈指令可以是具体的调整要求,比如“优化场景光影强度以增强层次感”,AI模型会根据接收到的反馈指令对自身生成逻辑进行调整,并基于调整后的逻辑进行二次创作生成。

3.1.2开发领域适配的专用模型

针对3D扫描数据格式多样、AI模型适配性低的问题,需开发针对数字媒体艺术特定领域的专用AI模型,提升模型对3D扫描数据的兼容性与处理能力[2]。专用模型采用模块化软件架构,核心包含格式解析模块、数据优化模块与领域适配模块。格式解析模块兼容点云格式(PLY、PCD)与网格格式(OBJ、STL、FBX),内置Assimp库格式转换引擎实现自动格式适配,无需创作者手动转换;数据优化模块集成RANSAC噪声修复算法与特征强化算法,提升扫描数据的质量;领域适配模块针对不同创作场景进行算法定制化优化。

例如,针对3D角色设计领域,开发“角色扫描—AI优化”专用模型,该模型支持读取多种格式的人体扫描数据,通过RANSAC算法自动修复扫描数据中的噪声点与缺失部分,同时集成面部特征点检测算法(如Dlib 68点模型),自动识别扫描面部的眼、鼻、口等关键器官位置,确保风格化优化(如卡通化、写实化)时不丢失面部辨识度。针对场景渲染领域,开发“场景扫描—AI渲染”专用模型,该模型可基于3D扫描的场景数据,自动识别场景中的物体类型,并根据创作者指定的风格,生成对应的光影效果与纹理贴图。

3.1.3混合现实(MR)中的实时AI场景重构技术

针对MR实时数字媒体艺术创作中的算力制约与延迟问题,需结合3D扫描与边缘计算技术,开发实时AI场景重构技术[3]。硬件层面采用“MR头显+边缘服务器”的协同架构:MR头显内置3D扫描模块,实时获取观众的肢体动作数据与展览空间的场景数据;边缘计算机采用Qualcomm Snapdragon XR2 Gen 2处理器,优化计算机硬件配置与算法效率,支持每秒1.2亿点云数据的实时处理,通过5G网络(时延≤10ms)与头显实现数据交互。

数据处理流程采用“轻量化预处理+快速生成”的逻辑:边缘计算设备对3D扫描数据进行实时预处理,即通过Octree算法将点云数据压缩至原体积的15%~20%,提取包含空间位置(X/Y/Z)、表面法向量(Nx/Ny/Nz)、颜色信息(R/G/B)的7维特征向量;采用PCA(主成分分析)算法对特征向量进行降维,在降低计算机运算负荷的同时保障数据核心特征,实现轻量化与高质量的平衡。

3.1.4基于注意力机制的3D风格迁移精准适配算法

针对传统风格迁移算法在处理3D扫描数据时易丢失核心结构特征、风格与形态适配性差的问题,新增基于注意力机制的3D风格迁移精准适配算法,实现“结构保留—风格适配—细节优化”的三重目标。算法采用“特征提取—注意力分配—风格融合”的三级架构,核心适配3D扫描的点云与网格数据,兼顾艺术风格的还原度与扫描对象的本质特征。特征提取模块采用PointNet++网络,分别提取3D扫描数据的几何结构特征与纹理细节特征,生成双路特征向量,避免单一特征提取导致的信息缺失。注意力权重分配模块通过自注意力机制,自动识别扫描对象的核心结构并分配高权重(0.7~0.9),对次要细节分配低权重(0.3~0.5),确保风格迁移时核心结构不被扭曲。风格融合模块采用自适应权重融合算法,根据目标风格类型动态调整融合系数,例如迁移国风风格时,提升线条纹理的融合权重,迁移赛博朋克风格时,强化色彩对比与光影特效的融合强度。

3.2艺术语言重构与技术落地协同方法

3.2.1基于GAN的超现实视觉语法建构与算法实现

生成对抗网络(GAN)的训练与推理需依托计算机的高性能计算单元。结合3D扫描数据,可利用GAN探索超现实的视觉语法,构建“现实元素—算法重构—超现实形态”的艺术表达逻辑[4]。GAN模型采用“深层卷积+注意力机制”的网络结构,生成器包含8层转置卷积层,每层搭配BatchNorm归一化与LeakyReLU激活函数,最后一层采用Tanh激活函数输出3D模型数据。判别器采用6层卷积层,通过Sigmoid激活函数输出真假判断概率,注意力机制模块(CBAM)嵌入生成器的中间层,强化关键特征的提取与融合。

例如,艺术家将3D扫描获取的鲸鱼模型与城市建筑模型输入GAN,生成器基于鲸鱼的流线型形态与建筑的立体结构,生成“鲸鱼身体与摩天大楼融合”的超现实3D模型。模型保留了鲸鱼的整体轮廓,但身体部分由玻璃幕墙与钢结构组成,背部伸出高耸的建筑尖顶,形成“生物与工业”融合的超现实视觉效果。判别器通过评估模型的“异化程度”与“视觉协调性”,引导生成器优化细节,最终形成符合超现实视觉语法的艺术作品。

3.2.2强化学习驱动的动态叙事自适应算法与架构设计

动态叙事的核心需求是实现“用户行为—叙事情节”的实时适配,基于强化学习(RL)的算法设计可有效提升叙事的灵活性与针对性。该技术采用“数据采集—模型训练—实时决策”的软件架构,核心模块包括数据融合模块、PPO2强化学习模块与叙事执行模块,数据融合模块负责整合3D扫描的场景数据与动作捕捉的用户行为数据,强化学习模块负责训练叙事决策模型,叙事执行模块负责根据决策结果调整叙事元素。

强化学习模型采用PPO2(Proximal Policy Opti mization)框架,设定叙事目标并转化为多目标奖励函数:奖励函数=探索进度得分(权重0.4)+情绪反馈得分(权重0.3)+叙事连贯性得分(权重0.3)。其中,探索进度得分通过用户与场景道具的交互次数(如触碰隐藏开关)量化(0-10分);情绪反馈得分通过MTCNN+FER-2013面部识别模型实时获取用户表情(喜悦/惊讶/紧张)并量化(0-10分);叙事连贯性得分通过预训练的BERT模型评估当前情节与上下文的匹配度(0-10分)[5]。

模型训练参数设置为:学习率3e-4,批次大小64,迭代次数1000轮。每轮根据用户行为更新叙事元素权重(如对话触发概率、场景灯光变化频率),例如当用户探索进度低于3分时,模型自动提升“引导性道具”(如发光钥匙)的出现概率(从10%提升至40%),同时降低场景灯光亮度(从0.8降至0.4)以营造紧张氛围,确保叙事与用户互动的动态适配。

3.2.3 GAN驱动的“意外美学”挖掘算法与筛选机制

“意外美学”源于AI处理3D扫描数据时的非预期效果,其挖掘核心在于通过算法设计保留并优化有价值的意外特征[6]。核心算法包括噪声注入算法、多尺度特征融合算法与双指标筛选算法,通过软件模块的协同运作,实现从意外效果产生到优质美学特征筛选的全流程控制。具体而言,在GAN处理3D扫描数据时,刻意保留扫描数据中的高斯噪声(均值0,标准差0.002~0.005),生成器在特征提取阶段不进行噪声过滤,而是通过多尺度特征融合(1×1卷积与3×3卷积结合)放大噪声带来的纹理变异。

建立双指标评估体系筛选意外效果,采用“视觉熵值”与“风格一致性”两个量化指标进行评估。视觉熵值通过计算体素颜色分布的信息熵(阈值设为4.5~6.0),筛选细节丰富度高的意外效果(如熵值5.2的“像素化纹理”优于熵值3.8的“单一纹理”);风格一致性通过预训练的VGG-19模型提取意外效果的特征,计算与目标风格(如抽象表现主义)的余弦相似度(阈值设为0.7以上),确保意外效果与整体艺术风格匹配。

例如,创作者通过3D扫描获取大理石雕塑的模型数据,输入GAN进行处理,AI因扫描数据中的噪声点,生成了“大理石纹理与像素颗粒混搭”的意外效果。雕塑的表面部分呈现大理石的细腻纹理,部分则分解为像素颗粒,形成“现实与数字融合”的视觉效果,创作者发现这种效果具有独特的美学价值,将其保留并优化,最终生成以“意外像素纹理”为核心的数字艺术作品。

4结语

人工智能、计算机技术与3D扫描建模技术的融合正在重塑数字媒体艺术创作的逻辑与形态。未来,随着计算机算力的持续提升、操作系统的不断优化以及AI算法的迭代升级,数字媒体艺术创作将进入“人机协同深度融合”的新阶段。计算机将作为更高效的技术载体,连接人工智能与创作者,让AI不再是简单的辅助工具,而是与人类创作者平等协作的“创意伙伴”,共同探索艺术的边界。

参考文献

[1]齐景怡.人工智能驱动的数字媒体艺术创新与实践研究[J].科技资讯,2025,23(13):23-25.

[2]晁永光.人工智能在数字媒体艺术创作中的应用研究[J].大众文艺,2024(24):95-97.

[3]殷莉.人工智能技术在数字媒体艺术设计中的应用[J].公关世界,2024(20):28-30.

[4]贾磊.基于人工智能的计算机辅助数字媒体艺术创作[J].科技创新与应用,2024,14(17):59-62.

[5]谭美凤.人工智能技术在数字媒体艺术中的应用与创新[J].丝网印刷,2024(8):89-91.

[6]王常圣.人工智能驱动的数字图像艺术创作:方法与案例分析[J].智能科学与技术学报,2023,5(3):406-414.