基于分类增强的 Transformer 语义分割方法论文

2026-03-26 15:39:28 来源: 作者:xuling

摘要:在ADE20K和Cityscapes数据集上的实验结果表明,本文所提出的CATNet在保持中等参数量(114.2M)的前提下,实现了对比方法中最优的分割精度,充分验证了分类引导机制在提升语义分割性能方面的有效性与通用性。

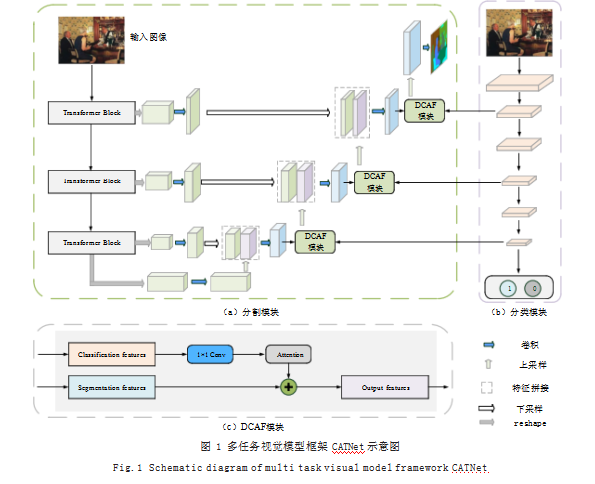

摘要:本文提出了一种融合图像分类语义引导的分割框架CATNet(Classification-Aided Transformer Network)。该方法将图像分类作为辅助任务引入分割流程,通过设计分类引导注意力机制(Classification-Aware Attention,CAA)与双通道特征融合模块(Dual-Channel Aggregation Fusion,DCAF),实现任务间深度语义协同。具体地,分割支路采用轻量级U-Net编码器以提取结构特征,分类支路采用ViT-B/16捕获全局语义。分类引导注意力机制通过分类特征生成显著性引导图,引导分割支路关注关键区域,而双通道特征融合模块进一步促进任务间特征共享与互补。在ADE20K和Cityscapes数据集上的实验结果表明,本文所提出的CATNet在保持中等参数量(114.2M)的前提下,实现了对比方法中最优的分割精度,充分验证了分类引导机制在提升语义分割性能方面的有效性与通用性。

关键词:多任务学习;图像分类;语义分割;Transformer;注意力机制

0引言

语义分割作为计算机视觉中的核心任务[1],致力于为图像中每一个像素赋予精确的语义标签,被广泛应用于自动驾驶、场景理解以及医学图像中各类病灶的语义分割等领域[2]。近年来,随着深度神经网络的发展,基于编码—解码结构的分割方法(如FCN[3]、DeepLab系列[4])取得了显著进展。然而,此类方法多聚焦于像素级结构建模,缺乏对图像整体语义的全局感知,常常导致目标边界模糊、类别混淆等问题,尤其在复杂场景下表现更为明显。多任务学习为缓解上述问题提供了新的思路,尤其是将图像级分类任务引入分割框架[5],有望通过全局语义引导提升像素级预测的语义一致性与判别性。已有研究尝试利用共享特征或并行优化策略融合分类与分割任务,但大多忽略了任务间信息传递的方向性与显式机制,难以充分发挥图像级语义对像素级推理的引导作用。为此,本文提出了一种融合图像分类语义引导的分割框架CATNet(Classification-Aided Transformer Network)。该方法设计了分类引导注意力机制(Classification-Aware Attention,CAA)与双通道特征融合模块(Dual-Channel Aggregation Fusion,DCAF),实现了图像级分类结果对分割过程的显式引导与语义补充。具体而言,CATNet包含两个协同分支:基于U-Net的分割分支侧重结构细节建模,基于Transformer的分类分支负责全局语义提取,两者通过注意力反馈与特征融合实现语义结构互补,显著提升了模型在复杂场景中的分割准确性与泛化能力。总地来说,本文的贡献主要如下:提出了一种基于分类语义引导的多任务语义分割网络CATNet;设计了分类引导注意力机制与通道级融合模块,实现了任务间的高效协同建模;在多个语义分割数据集上验证了本方法在精度与参数效率上的优越性。

1方法

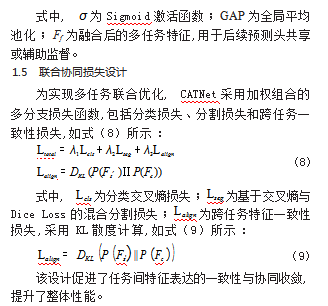

为提升图像分类与分割任务之间的协同能力,本文提出了一种统一的多任务视觉模型融合图像分类语义引导的分割框架CATNet(Classification-Aided Transformer Network),如图1所示。该方法引入了分类引导注意力机制[6],通过Transformer分类分支所捕获的全局语义信息,辅助分割模块聚焦于语义显著区域,显著增强了目标边界的建模能力与分割结果的结构一致性。CATNet由三个主要模块组成:(1)分割模块,提取局部结构特征;(2)分类模块,建模图像的全局上下文表示;(3)双通道特征融合模块,通过分类引导注意力机制与双通道注意力融合(DCAF)机制,实现任务级知识反馈与特征互补。

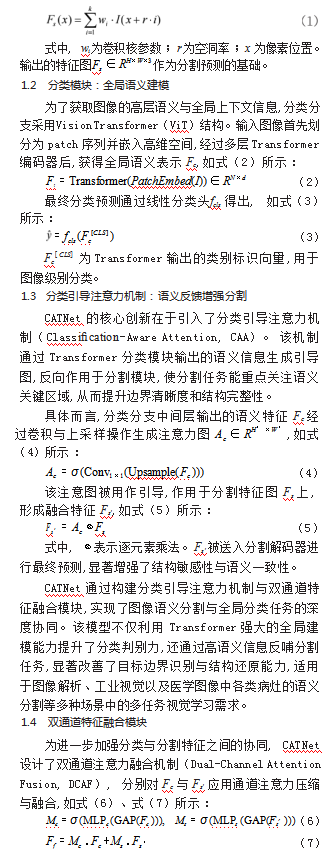

1.1分割模块:局部结构建模

为提取像素级的结构与语义边界信息,CATNet采用基于U-Net的分割模块作为编码器—解码器框架,并在下采样阶段引入空洞卷积(Atrous Convolution)增强感受野,从而提升模型对多尺度结构的捕捉能力。设输入图像为I∈RH×W×3,其特征提取过程如式(1)所示:

2实验

2.1数据集与评价指标

为验证本文提出的CATNet模型在通用图像分类与分割任务中的有效性,在ADE20K与Cityscapes两个广泛使用的公开数据集上进行评估。ADE20K数据集包含超过20000张图像,涵盖150个语义类别,包括多种室内和室外场景。采用mIoU(mean Intersectionover Union)和像素准确率(Pixel Accuracy)评估分割效果,同时将场景类别作为分类目标进行准确率评估。Cityscapes数据集主要用于城市街景下的语义分割任务,包含19个评估类别。将场景分类任务设定为白天/夜间场景识别,并以Top-1Accuracy评估分类性能,同时使用mIoU评估语义分割质量。

2.2实验设置

统一使用PyTorch框架实现CATNet,模型训练在配备NVIDIA RTX 4090 GPU的服务器上进行,优化器选择AdamW,初始学习率设为0.001,并采用余弦退火策略进行动态调整,训练周期设为160,批量大小为16。数据增强策略包括随机裁剪、水平翻转以及色彩扰动,以提升模型的泛化能力。模型采用交叉熵与Dice损失组合进行分割任务优化,分类任务采用标准的交叉熵损失,同时引入KL散度度量的跨任务一致性损失以促进特征协同表达。

2.3实验结果

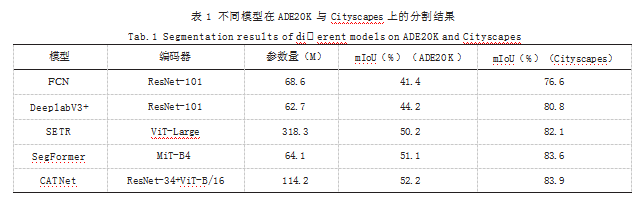

多种代表性分割模型在ADE20K和Cityscapes数据集上的性能表现及其主干网络参数规模如表1所示。从结果来看,传统基于卷积的模型如FCN和DeepLabV3+分别使用ResNet-101编码器,在两项任务中均取得了较为稳定的分割精度,其中DeepLabV3+在ADE20K上达到了44.2%的mIoU,优于FCN的41.4%,验证了空洞卷积对感受野扩展的有效性。基于纯Transformer架构的SETR借助ViT-Large的强大建模能力[7],将ADE20K上的mIoU提升至50.2%,但其参数规模高达318.3M,计算资源开销显著。SegFormer在结构设计上实现了参数与精度的良好权衡,MiT-B4主干下实现了51.1%的mIoU,参数控制在64.1M。

相比之下,本文所提出的CATNet采用由ResNet-34和ViT-B/16组成的双主干结构,在参数量仅为114.2M的情况下,在ADE20K上取得了52.2%的mIoU,在Cityscapes上亦达到83.9%,均为当前对比方法中的最佳结果。尽管CATNet的参数量略高于SegFormer,但性能提升更为显著,相较于DeepLabV3+和SETR,在不依赖重型主干网络的前提下实现了更优的分割精度。分析表明,CATNet在结构上通过引入分类引导注意机制与双通道特征融合策略,实现了跨任务语义增强与特征共享,有效提升了模型对目标边界与多类别结构的感知能力。综合上述对比结果可见,CATNet在分割精度与模型规模之间实现了较优的平衡,在不显著增加参数负担的前提下,有效提升了模型的整体语义理解能力,展现出良好的通用性与部署潜力。

3结语

本文提出了一种统一的多任务视觉融合图像分类语义引导的分割框架CATNet,通过引入分类引导注意力机制和双通道注意力融合模块,实现了图像分类与语义分割任务间的深度耦合与协同优化。该方法充分利用Transformer的全局建模能力与U-Net的空间结构优势,在多个公开数据集上显著提升了分类准确性与分割精度。实验结果表明,CATNet不仅在图像级语义判别上具备强鲁棒性,在像素级结构恢复任务中同样表现优越;所引入的语义反馈机制和特征融合策略对模型性能提升具有关键作用。CATNet具备在工业检测、医学图像理解,特别是医学病灶的分割和诊断等多种实际场景中的应用潜力。

参考文献

[1]严毅,邓超,李琳,等.深度学习背景下的图像语义分割方法综述[J].中国图象图形学报,2023,28(11):3342-3362.

[2]梁浩城,吕佳,于明楷,等.融合先验式图卷积与Transformer的儿童肺炎CT图像分割网络[J].光学学报,2024,44(16):96-110.

[3]LONG J,SHELHAMER E,DARRELL T.Fully Convolutional Networks for Semantic Segmentation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2015:3431-3440.

[4]CHEN L C,ZHU Y,PAPANDREOU G,et al.Encoder-decoder with Atrous Separable Convolution for Semantic Image Segmentation[C]//Proceedings of the European conference on computer vision(ECCV),2018:801-818.

[5]张珂,冯晓晗,郭玉荣,等.图像分类的深度卷积神经网络模型综述[J].中国图象图形学报,2021,26(10):2305-2325.

[6]任欢,王旭光.注意力机制综述[J].计算机应用,2021,41(S1):1-6.

[7]ZHENG S,LU J,ZHAO H,et al.Rethinking Semantic Segmentation from a Sequence-to-sequence Perspective with Transformers[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2021:6881-6890.